DOI del artículo: https://doi.org/10.22201/dgtic.26832968e.2022.7.1

4/6

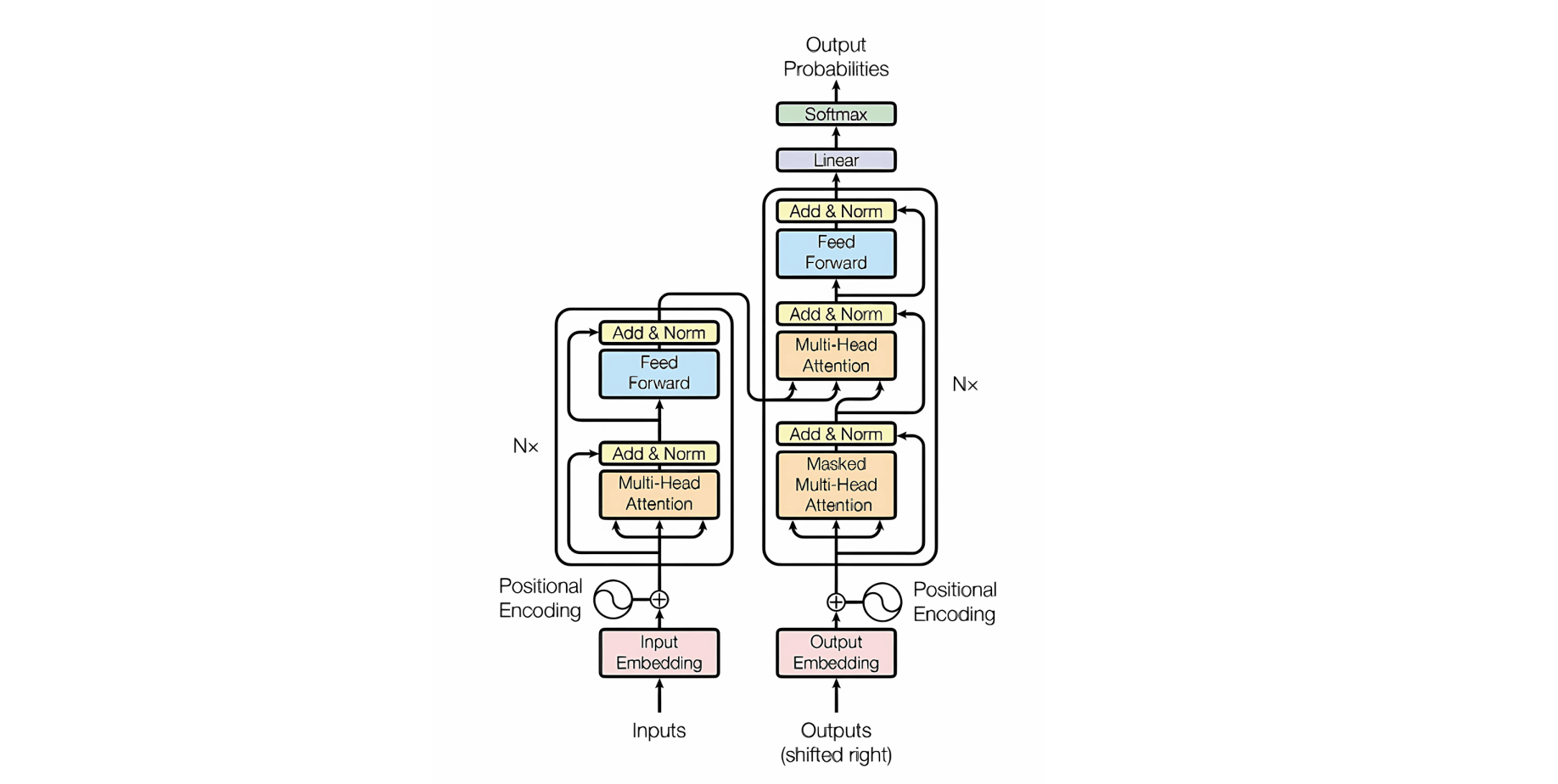

Los Transformadores son un modelo de aprendizaje computacional basado en RN. La característica principal se centra en el concepto de atención, el cual permite hacer ajustes particularmente enfocados a la composición de las neuronas durante el proceso de entrenamiento de la RN. Un caso exitoso basado en Transformadores es el llamado Representación Bidireccional de Codificadores de Transformadores, BERT por sus siglas en inglés [17]. Este modelo propone la paralelización de ciertas tareas durante el proceso de entrenamiento de la RN. En la figura 2, se representa gráficamente la arquitectura de este modelo.

Figura 2. A. Vaswani, et al., "Arquitectura del modelo de Transformadores", 2017. Fuente: A. Vaswani, et al., "Attention is all you need", Advances in neural information processing systems, 2017.

En el idioma inglés, el modelo BERT ha logrado una precisión de hasta el 92.8% para la tarea de Extracción de Entidades (NER) [16]. Para el idioma castellano, hay estudios que concluyen hasta un 88.43% de precisión para NER [18].

En el contexto de publicaciones en redes sociales, en [19] se aplica el modelo BERT para NER en castellano [18]. Esta prueba, concretamente, se llevó a cabo en Twitter, en donde la NER reportó una precisión de 93%. Sin embargo, la extracción de las entidades relacionadas con la ubicación no fue suficiente para determinar si la publicación se realizó en la ubicación extraída. Por lo que en [19] también se reportó la recolección de 220,426 publicaciones en Twitter que contaban con la ubicación habilitada. Las entidades extraídas concernientes a la ubicación coincidieron en un 29%.

Adicionalmente, al experimento NER descrito en [19] con el modelo BERT, se realizó otro sondeo para detectar publicaciones en Twitter sobre COVID-19. En concreto, se buscaron publicaciones con las palabras “COVID” y “contagio”. Se analizaron 104,035 tuits, de los cuales 15,050 estaban escritos en idioma castellano. De estas últimas publicaciones, se detectaron 3,369 publicaciones relacionadas con alguna ubicación geográfica. Finalmente, el algoritmo detectó 15 publicaciones sobre COVID-19 con la ubicación geográfica correctamente. Este resultado se obtuvo de un total 76 tuits con la ubicación geográfica habilitada.

Fecha de recepción: 23 de noviembre de 2021

Fecha de publicación: marzo de 2023